作者简介: 于丰华, 1989年生, 沈阳农业大学信息与电气工程学院副教授 e-mail: adan@syau.edu.cn

开展水稻无人机高光谱解混, 获取水稻植株的高光谱反射率信息, 对于提高水稻理化参量的反演模型精度具有重要意义。 目前大多基于高光谱遥感影像自身数据进行解混, 运用算法模型进行高光谱数据解混, 将高光谱图像和可见光图像进行优势互补, 提出一种基于无人机高清影像与高光谱遥感影像融合的稻田无人机高光谱解混方法, 解决单一数据局限性问题, 增强光谱数据对地物的描述能力。 为了更好的计算端元丰度, 将同一目标区的高清数码正射影像与无人机高光谱遥感影像利用经纬度信息进行空间配准, 使得不同传感器获得的图片在几何位置上对齐, 通过SVM分类器的监督分类方法对可见光的数码正射影像进行地物分类, 利用地物分类的结果对应高光谱的一个像元, 从而得到一个像元内的端元丰度。 设相邻区域内的水体端元是相同的, 利用线性解混模型(LSMM)对相邻区域的混合像元进行解混, 最终获取水稻高光谱反射率信息。 结果表明对两种图片进行空间配准丰富了数据源信息, 有利于像元的端元丰度计算, 其中水稻端元丰度在70%以上解混效果最好, 丰度在50%以上解混效果一般, 丰度在30%以下解混效果较差; 选择监督分类方法进行地物分类, 精度达到99.5%, 面向对象方法分类精度为98.2%, 监督分类方法优于面向对象分类方法; 最终得到的混合像元分解反射率高于原混合像元反射率, 减少了水体混合部分对光谱数据的影响, 使得分解后水稻的光谱反射率更加准确, 为水稻理化参量无人机成像高光谱遥感反演提供更加准确的科学依据。

Conducting the unmanned aerial vehicle (UAV) hyperspectral unmixing of rice and obtaining the hyperspectral reflectance information of rice plants is of great significance for improving the accuracy of the inversion model of rice physical and chemical parameters. Most of the current research is based on the data of hyperspectral remote sensing images themselves for demixing. That is, unmixing of hyperspectral data is carried out by using algorithm model. In this study, the advantages of hyperspectral images and visible spectral images were complemented, and a hyperspectral unmixing method for UAV in rice field was based on the fusion of UAV high-definition images and hyperspectral images remote sensing images was proposed. This method solved the problem of the limitation of single data and enhanced the description ability of spectral data for ground objects. In order to better calculate the endmember abundance, the high-definition digital orthophotos of the target area were spatially aligned with the UAV hyperspectral remote sensing images, so that the pictures obtained by different sensors were aligned in geometric positions. The supervised classification method of the SVM classifier was used to classify the digital orthophoto of visible light, and the result of the classification was used to correspond to a pixel of the hyperspectrum to obtain the endmember abundance within a pixel. Suppose the endmembers of the water body in adjacent areas were the same, the linear unmixing model (LSMM) was used to unmix the mixed pixels in the adjacent area and finally the hyperspectral reflectance information of rice was obtained. The results showed that the spatial registration of the two images enriches the data source information, which was beneficial to the endmember abundance calculation of the pixels. Among them, the unmixing effect of rice endmember abundance above 70% was the best, the unmixing effect of abundance above 50% was general, and the unmixing effect was poor when the abundance was below 30%. Use the supervised classification method to classify the ground objects with an accuracy of 99.5%, and the classification accuracy of the object-oriented method was 98.2%, the supervised classification method was better than the object-oriented classification method. The final decomposition reflectance of the mixed pixel was higher than that of the original mixed pixel, which reduced the influence of the mixed part of the water body on the spectral data, and made the spectral reflectance of the rice after decomposition more accurate. This research could provide a theoretical basis for the inversion of the UAV imaging hyperspectral remote sensing of rice physical and chemical parameters.

无人机高光谱遥感技术因其平台具有较高的便捷性、 灵活性, 常用于水稻营养诊断、 病害预警、 表型检测等定量遥感研究, 已逐渐成为水稻低空遥感研究重要的数据获取手段[1, 2]。 水稻作为典型的大田行播作物, 生长周期内有较长时间冠层处于非均质状态, 即无人机高光谱平台获取的遥感影像数据中除了水稻外, 还包括水体、 土壤等地物[3]。 受制于目前高光谱成像仪空间分辨率的限制, 无人机高光谱遥感平台获取的高光谱遥感影像中, 单一像元中极易出现水稻、 水体、 土壤等多种地物共同存在的混合像元。 混合光谱的存在, 会造成水稻理化参量高光谱反演模型精度的下降。 因此, 开展水稻无人机高光谱解混, 获取水稻植株的高光谱反射率信息, 是利用无人机成像高光谱开展水稻定量遥感的重要前提。

高光谱影像混合像元分解主要包括: 端元数目估计、 端元提取以及丰度估计三部分。 通常情况下稻田内的端元数目是已知的, 因此如何准确对稻田无人机高光谱影像进行端元提取与丰度估计是实现稻田高光谱影像混合像元分解的关键。 由于无人机搭载的高光谱成像仪距离探测目标通常比较远, 导致其所拍摄的高光谱图像分辨率不足, 图像中单个像元中经常包含多种难以分辨的物体。 而可见光图像由于其通常具有较高的空间分辨率, 可以提供清晰的地物边缘、 纹理和颜色等空间特性, 增强了对地物的描述能力[4, 5]。 充分利用高光谱图像的光谱信息和可见光图像的纹理、 颜色等信息, 进行优势互补, 克服单一数据源的局限性, 从而增强对地物目标的描述能力, 这对地物的光谱影像进行端元提取与丰度估计具有重要的意义[6, 7]。

综上所述, 针对现有高光谱影像解混方法的不足, 提出一种基于无人机高清影像与高光谱遥感影像融合的稻田无人机高光谱解混方法, 首先利用同一地块的高清数码正射影像与无人机高光谱遥感影像进行空间配准, 再利用可见光的数码正射影像进行地物分类, 将分类结果与高光谱像元进行匹配, 计算每一个高光谱像元的端元丰度, 再利用线性解混模型对无人机高光谱遥感影像进行解混, 最终获取水稻高光谱反射率信息, 为水稻理化参量无人机成像高光谱遥感反演提供科学基础。

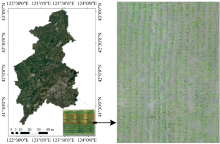

试验地点位于辽宁省沈阳市沈北新区柳条河村(北纬42° 01'17.16″, 东经123° 38'14.57″), 月平均气温最高24.6 ℃, 最低-12.7 ℃。 平均年降水量为755.4 mm, 降水日数历年平均为93.8 d, 全年晴天平均为136.7 d, 雨天为145.4 d。 属于典型的寒地水稻种植区, 试验品种为辽宁地区广泛种植的“ 粳优653” 品种。 试验于2020年5月— 6月进行, 涉及水稻的返青期和分蘖期两个生育期, 这两个生育期内, 稻田内处于未封行的非均质状态。 数据采集过程中天气晴好, 如遇雨天或不利于无人机遥感数据采集天气则顺延采集。

1.2.1 水稻冠层无人机高光谱遥感影像获取

采用深圳大疆创新公司的M600 PRO六旋翼无人机作为飞行平台, 高光谱成像仪选用四川双利合谱公司的GaiaSky-mini内置推扫式机载高光谱成像系统, 高光谱的波段范围为400~1 000 nm, 分辨率为3.5 nm, 有效波段数为170个, 单幅影像获取时间为15 s, 帧速为162帧· s-1, 无人机飞行高度为100 m, 空间分辨率为7 cm。 由于水稻分蘖期稻田内水体面积很大, 为避免镜面反射等干扰, 将无人机高光谱数据采集时间选择在09:00— 09:30之间, 同时为了降低由于太阳高度角变化对高光谱影像采集造成的测量误差, 无人机高光谱影像获取过程中每隔5 min进行1次定标白板(反射率> 99%)和仪器背景暗噪声光谱数据的采集, 用于后期计算高光谱影像反射率。 在每景高光谱采集区域内放置一块1.5 m× 1.5 m、 反射率为60%的漫反射板, 用于后期的反射数据校正[8]。 利用机载高光谱成像仪配套的SpectraVIEW软件对所获取的无人机高光谱遥感影像进行镜头、 均匀性、 反射率等预处理, 最终获得用于解混的高光谱反射率影像。

1.2.2 稻田无人机高清数码正射影像采集

采用深圳大疆创新公司的Phantom 4 RTK四旋翼无人机作为飞行平台, 无人机内置RTK差分定位系统, 定位精度为1 cm+1 ppm, 1 ppm指飞行器每逸动1 km误差增加1 mm。 内置相机有效像素2 000万, 飞行高度50 m的条件下分辨率为1.5 cm。 利用大疆飞行软件对试验区进行航线规划, 采用定时拍照的方式获取试验田正射影像原始数据[9]。 采用Pix4D图像处理软件对无人机采集的试验区影像进行正射拼接、 裁剪等过程, 最终获得用于解混的稻田高清正射影像。

1.2.3 高光谱影像混合像元分解实验数据获取

利用无人机高光谱成像仪获得高光谱反射率影像后, 对目标实验区选择一定区域, 且每个区域的6种待解混像元均在同一邻域内, 实验结果证明在同一领域内选取不同丰度的像元对于混合像元分解更精确, 因此实验数据所用的样本均在高光谱影像上获取, 选择五组分布距离差异大的区域, 每个区域取相邻的6种不同丰度的像元进行分解, 另选择五组区域进行方法验证, 实验样本数据量共为60条。

1.3.1 稻田无人机多源遥感影像配准

高光谱遥感影像具有丰富的地物光谱信息, 可以通过光谱信息的差异来辨识地物的类别, 但空间分辨率较低。 可见光影像的空间分辨率较高, 影像清晰, 在辨识地物的形状和轮廓优势明显。 本研究利用无人机拍摄的包含经纬度信息的可见光正射影像与高光谱影像进行配准, 将这些在不同传感器获得的同一场景下的图像在几何位置上对齐, 综合的利用多幅图像的优势信息来提高地表分类精度以及满足亚像元级目标探测的需求。

采用基于人工目视解译特征的配准方法对高光谱影像进行配准。 此方法通过提取两幅影像内相同的多个特征信息, 其中人工目视解译方法提取特征对图像中的噪声具有较强的抑制能力, 能够准确检测出两幅图像的共有特征。 根据提取的特征点, 计算影像之间的X残差、 Y残差、 均方根误差以及均方根总误差进行配准, 配准的精度小于0.5个像元, 适用于不同传感器不同波段图像之间的配准。 当计算误差在配准精度要求范围之内时, 由坐标变换参数以及最近邻差值进行高光谱配准。 结果如图2所示。

| 图2 高光谱遥感影像(a)和可见光影像(b)的配准结果(c)Fig.2 Registration results of visible light image (b) and hyperspectral remote sensing image (a) |

1.3.2 稻田无人机高光谱端元提取

水稻分蘖期, 田内处于灌水状态, 稻田地物构成主要包括水稻植株与水体。 水体实质是水、 土壤等地物构成的混合物质, 并不是严格意义上的单一地物类型。 而水稻由于长势、 结构等多因素控制, 即使“ 纯水稻” 像元之间的高光谱也会存在差异。 因此精准提取“ 纯水体” 像元是高光谱解混的重要前提。 同一田块水体内, 不同位置的水体高光谱反射率存在一定的差异, 为了保证最终解混的准确性, 结合高清数码影像分类结果, 采用邻域空间搜索法确定稻田水体的高光谱端元反射率。

首先利用高分辨率的无人机数码正射影像进行分类, 将分类结果与高光谱影像做像素级融合配准, 若一个高光谱像素点范围内所覆盖的可见光像素点均为相同分类结果时, 则认为该高光谱像元为纯净像元。 无人机高光谱遥感平台飞行高度100 m的条件下, 其空间分辨率为7 cm, 而这期间稻田内水体的占比很大, 可以保证影像内一定存在“ 纯水体” 像元。 无人机所获取的稻田遥感影像中将存在若干水体纯像元, 选择待解混像元最近的水体纯像元作为解混的水体端元高光谱反射率信息。

1.3.3 稻田无人机可见光影像分类

首先, 处理无人机高清影像和高光谱影像, 将两种图像的地理位置信息完全配准, 依据影像具有相同坐标信息这一特点, 分析高光谱单个像元中包含高清影像端元的数量, 对于混合像元中的各个物质进行丰度估计。 其次对高清影像选取适当的波段进行分类, 利用监督分类中的支持向量机方法, 自动寻找图像中有较大分类区分能力的支持向量, 将类与类之间的间隔最大化获取较好的分类精度。

支持向量机(SVM)是一种二分类模型, SVM的学习策略就是间隔最大化, 可形式化一个凸二次规划的求解问题。

SVM想要的就是找到各类样本点到超平面的距离最远, 也就是找到最大间隔超平面。 任意超平面可以用下面这个线性方程来描述[6]

二维空间点(x, y)到直线Ax+By+C=0的距离公式是

扩展到n维空间后, 点x=(y1, x2, …, xn)到直线ω Tx+b=0的距离为

于是可得公式

每个支持向量到超平面的距离可以写为

最大化这个距离

这里乘上2倍也是为了后面推导, 对目标函数没有影响。 刚刚我们得到支持向量y(ω Tx+b)=1, 所以我们得到

最终得到的最优化问题是

1.3.4 水稻无人机高光谱混合像元解混

采用线性光谱混合模型(linear spectral mixture model, LSMM)对试验田的无人机高光谱遥感影像进行解混, LSMM的数学表达如式(9)所示[7]

式(9)中, R是n(n为波段数量)维的已知高光谱图像; H是n× q(q为端元数目)的端元矩阵, 每一列代表一个端元的光谱向量; 向量s是像元中各端元的丰度; We是n维的高斯随机噪声。 如果把高光谱图像的全部γ (假设γ 为像元个数)个像元均考虑进式(1), 则式(1)可扩展为

式(10)中, R∈ Tn× C, T为非负矩阵, 列向量为每个像元的光谱值; V∈ TQ× C为丰度矩阵或称混合矩阵。 V存在两个约束条件, 非负性约束

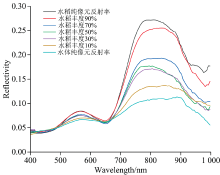

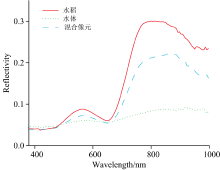

水稻分蘖期处于营养生长阶段, 水稻冠层高光谱反射率主要反映了叶片高光谱信息, 通过ASD地物光谱仪, 分别测量试验田内水稻叶片、 水层、 冠层混合高光谱反射率信息, 如图3所示。

| 图3 水稻像元、 水层像元、 混合像元高光谱反射率光谱Fig.3 Hyperspectral reflectance spectra of rice pixels, water layer pixels and mixed pixels |

由图3可知, 纯净的水稻与水层的高光谱反射率差异非常明显, 特别是在近红外波段范围, 而混合像元高光谱反射率信息则介于水稻、 水层两者反射率之间。 水体的反射率在400~1 000 nm范围内整体较低, 反射率的范围均小于0.1。 通过人工选取同一区域内水稻丰度在10%~90%之间的高光谱混合像元, 分析反射率变化规律发现(图4), 混合像元反射率在水稻、 水体丰度不同条件下, 近红外波段的反射率变化较为剧烈, 其中水稻丰度占比越高, 近红外波段反射率也越高。 随着混合像元内水稻丰度占比逐渐降低, 混合像元的红边会发生“ 红移” 现象。 与之相反的是随着混合像元水稻丰度的变化, 不同丰度的混合高光谱“ 红谷” 位置变化并不剧烈。 从400~1 000 nm范围内, 水稻、 水体不同丰度混合而成的高光谱反射率在可见光范围内变化较弱, 而在近红外范围内变化较为剧烈。

混合像元高光谱反射率信息则介于水稻、 水层两者反射率之间。 且当水稻丰度不足70%时, 由于水体的反射率很低, 因此整个混合高光谱反射率的信息主要反映了水体的信息, 而水稻的信息则表现不明显。 当水稻丰度低于50%以下, 则基本无法反映水稻的高光谱反射率信息。 这样的特征证明了利用光谱特征反演水稻理化参量时, 需要对获取的高光谱反射率进行解混, 否则会影响反演模型精度。

由于高光谱图像分辨率不足, 图像中单个像元中经常包含多种难以分辨的基本物质, 而可见光影像空间分辨率高, 拥有较高的地物描述能力[10, 11], 所以结合两者优势, 将同一地块的高清数码正射影像与无人机高光谱遥感影像进行空间配准, 再利用可见光的数码正射影像进行地物分类, 将分类结果与高光谱像元进行匹配, 通过分类结果来计算每一个高光谱像元的端元丰度。 所以, 对无人机可见光影像进行分类是高光谱像元丰度估计的前提。

首先对空间分辨率较高的无人机正射影像进行地物分类, 分别采用面向对象分类和采用SVM分类器的监督分类两种方法, 结果如图5所示。

采用混淆矩阵评价无人机高分辨正射影像的分类精度, 分类精度结果如表1所示。 由表1可知: 监督分类与面向对象的总体精度均比较理想, 分类精度分别为: 99.5%和98.2%。 两种方法的Kappa系数分别为0.99和0.95。 通过错分误差和漏分误差进行误差分析, 在监督分类结果中, 11 733个水体像元中错误分类的有49个, 错分误差为0.417%, 远低于面向对象1.99%的错分误差。 漏分误差结果表明, 监督分类对11 722个水体像元进行分类, 漏分的水体像元为38个, 漏分误差为0.32%, 略低于面向对象0.42%的漏分误差。 而对水稻像元的分类中, 监督分类的漏分误差为1.13%, 远低于面向对象5.47%的漏分误差。 综合数据分析, 采用监督分类的结果作为无人机高光谱像元丰度反演的基础。

| 表1 不同方法分类结果 Table 1 Classification results of different methods |

2.3.1 水体纯像元选择方法

无人机高光谱遥感影像数据在水稻的分蘖期获取, 此生育期内稻田均有水层覆盖, 且稻田内并无水棉、 杂草等干扰地物。 因此无人机平台所获取的高光谱遥感影像中仅含有水稻、 水体两种端元, 其中水体指水层和土壤混合而成一种端元。 因此准确估计高光谱混合像元内不同端元的丰度是实现高光谱解混的重点。

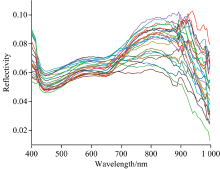

利用无人机高清正射影像的分类结果, 选取了24个均匀分布在试验田内的水体高光谱像元, 反射率如图6所示。

由反射率曲线可知, 由于养分、 土壤肥利、 环境胁迫等多因素的共同作用, 稻田内不同位置的水体像元存在一定差异, 无法找到一个标准光谱作为水稻端元; 在解混过程中, 选择离像元最近的水体纯像元作为端元, 尽量减小由于固定端元对解混精度的影响。

2.3.2 利用不同方法丰度估计比较

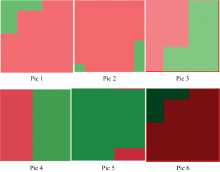

根据一个像元大小, 选用6组监督分类结果图比较不同丰度估计方法, 如图7所示。

丰度估计的方法是将高光谱影像与可见光影像配准, 然后对可见光影像监督分类, 配准后的两种影像能使苗的位置一一对应, 因此选择一个像元大小的分类结果图(如图7所示), 利用图像计算的方法, 算出水稻以及水体的丰度占比。 另一种方法利用ENVI扩展工具完全约束最小二乘法进行混合像元丰度估计, 能够直接计算出水稻和水体的占比。 两种方法的水稻丰度估计结果如表2。

| 表2 不同方法水稻丰度估计结果 Table 2 Results of rice abundance estimation by different methods |

从6组数据可以看出, ENVI完全约束最小二乘法混合像元丰度分解结果不稳定, 误差较大, 由于它在分类时自动寻找纯像元, 所分解的像元与水稻纯像元越接近, 丰度就高, 而可见光分类丰度估计是可见光影像分类后再寻找单个高光谱像元进行丰度估计, 监督分类结果精度达到99.5%, 因此该方法丰度分解结果较为准确。

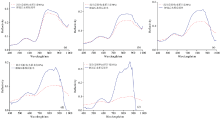

不同丰度条件下, 高光谱反射率解混结果如图8所示。

| 图8 不同端元丰度条件下混合像元解混结果Fig.8 Unmixing results of mixed pixels under different endmember abundance conditions |

由图8可知, 当水稻丰度占比大于70%以上时, 在400~1 000 nm范围内可见光反射率受水体干扰很小, 在近红外波段范围内, 随着水稻丰度的下降反射率有所降低。 解混后提升了近红外波段的反射率, 有效减少了水体对水稻高光谱反射率的干扰。 由图7(c)可知, 当混合像元内水稻丰度为50%时, 混合像元反射率在可见光范围内会受到轻微干扰, “ 绿峰” 反射率有所降低, “ 红谷” 特征未受影响, 反射率的“ 红边” 特征发生明显红移现象, 而在近红外波段反射率受影响较大。 由图8(d)和(e)可知, 当水稻丰度低于30%时混合像元反射率信息主要体现了水体的特征, 水稻高光谱反射率特征均收到较大干扰。 解混后能够基本恢复混合像元内水稻高光谱的主要特征。 但当水稻丰度占比较小时, 解混后容易出现水稻高光谱反射率提取失真的情况[图8(e)]。

传统的高光谱遥感混合像元分解主要是针对卫星遥感影像, 而近年来随着无人机高光谱遥感技术的逐渐成熟, 利用无人机高光谱遥感开展农业定量遥感的研究逐渐增加。 无人机高光谱相比于传统的卫星遥感在空间分辨率上有着巨大的优势, 现有卫星高光谱遥感影像的分辨率通常在米级, 而无人机高光谱遥感的分辨率往往在厘米级, 因此在前期的研究中大部分研究人员在利用无人机高光谱遥感影像开展定量遥感过程中很少考虑混合像元所带来的影像。 但对于尚未封行的行播作物来说, 前期水稻植株整体生物量、 LAI较少, 反射率容易被干扰地物所淹没, 而营养生长对整个生长过程至关重要, 也是遥感监测的重点。

传统单一利用高光谱遥感影像进行混合像元分解, 一般要求地物端元的高光谱反射率信息是恒定的, 对于水稻来说由于空间、 栽培、 环境等不同, 相同地块内的不同水稻长势有可能存在一定的差异, 因此无法利用固定端元进行解混。 由于无人机高清数码影像的分辨率要明显优于现有高光谱影像的空间分辨率。 因此利用可见光正射影像先进行分类, 利用分类结果与高光谱遥感影像进行配准, 从而计算高光谱混合像元内不同地物的丰度值。 这个过程的核心是对两幅分辨率不同的影像进行精准配准。 配准过程中仍然需要人工参与选取特征匹配点, 容易造成配准误差, 未来如何结合人工智能方法实现精准配准, 对于利用无人机高分辨率遥感影像来提升混合高光谱分解精度具有重要的意义。

针对水稻分蘖期、 拔节期等非封笼条件下, 无人机高光谱定量遥感中混合像元对水稻农情定量遥感建模精度的影响, 通过分析混合高光谱反射率特征。 结合无人机可见光正射遥感影像空间分辨率高的优势, 通过与无人机高光谱遥感影像配准、 分类等研究, 实现了水稻分蘖期无人机高光谱遥感影像混合像元分解。 具体结论如下:

(1)在水稻的分蘖期对无人机高清影像进行分类, 监督分类的分类方法优于面向对象分类方法。

(2)在近红外波段中, 利用线性光谱混合模型(LSMM)对高光谱混合像元进行解混后, 光谱反射率均有提升。

(3)混合像元中, 水稻丰度占比在70%以上时解混效果较好, 水稻丰度占比在30%以下解混效果较差。 水体丰度占比大于50%时, 水稻高光谱反射率特征将被掩盖。

| [1] |

|

| [2] |

|

| [3] |

|

| [4] |

|

| [5] |

|

| [6] |

|

| [7] |

|

| [8] |

|

| [9] |

|

| [10] |

|

| [11] |

|