作者简介: 郜世姣, 1996年生, 黑龙江八一农垦大学硕士研究生 e-mail: bynd_gsj@163.com

为解决大豆冠层在近地端的多光谱图像边缘灰度不均, 目标与背景之间灰度差别小, 难以准确高效地获取大豆冠层目标区域的难题, 将多光谱成像处理技术与经典图像分割方法有机融合, 提出基于多光谱图像处理技术的大豆冠层提取方法。 以东北大豆为对象, 通过Sequoia多光谱相机采集绿光、 近红外、 红光、 红边和可见光五类大豆多光谱图像, 采用高斯平滑滤波法对原始大豆多光谱图像进行预处理, 分析多光谱图像中大豆冠层和背景的灰度直方图分布特性, 在此基础上利用迭代法、 Otsu法和局部阈值法提取原大豆多光谱图像中冠层区域, 并以图像形态学开运算处理细化和扩张背景, 避免图像区域内干扰噪声对大豆冠层识别效果的影响, 同时以有效分割率、 过分割率、 欠分割率、 信息熵以及运行时间等为监督指标, 对大豆冠层多光谱图像识别模型进行效果评价。 大豆冠层识别模型中迭代法可以有效分割近红外和可见光大豆冠层图像, 有效分割率分别为97.81%和87.99%, 对绿光、 红光和红边大豆冠层图像分割效果较差, 有效分割率低于70%; Otsu法和局部阈值法可以有效分割除红光波段的其余四种多光谱大豆冠层图像, 且有效分割率均在82%以上; 三种算法对红光大豆冠层图像的有效分割率均低于20%, 未达到较好效果。 在原始多光谱图像中应用迭代法、 Otsu法和局部阈值法提取大豆冠层图像与标准图像的信息熵平均值波动幅度分别为: 0.120 1, 0.054 7和0.059 8, 其中Otsu法和局部阈值法较小, 表明了对于大豆冠层多光谱图像识别中两种算法的有效性。 该算法中Otsu法和局部阈值法均可以有效提取绿光、 近红外、 红边和可见光等多光谱的大豆冠层图像, 二者较为完整地保留了大豆冠层信息, 其中Otsu法实时性能较局部阈值法更好。 该成果为提取农作物冠层多光谱图像提供理论依据和技术借鉴。

To solve the problem that the edge gray level of the soybean canopy near the ground is uneven, the gray level difference between the target and the background is small, and it is difficult to accurately and efficiently obtain the soybean canopy target area. This paper combined the multispectral imaging processing technology with the classical image segmentation method and proposed a soybean canopy extraction method based on the multispectral image processing technology. Five kinds of soybean multispectral images, including green light, near-infrared, red light, red edge, and visible light, were collected by Sequoia multispectral camera. A Gaussian smoothing filter preprocessed the original soybean multispectral images. The distribution characteristics of the gray histogram of the soybean canopy and background were analyzed. On this basis, the iterative method, Otsu method, and local threshold method were used to extract the canopy region in the original soybean multispectral image, and the image morphological open operation was used to refine and expand the background to avoid the influence of the interference noise in the image region on the recognition effect of soybean canopy. At the same time, the effective segmentation rate, over-segmentation rate, under-segmentation rate, information entropy, and running time were taken as the monitoring indexes, and the effect of the soybean canopy multispectral image recognition model was evaluated. The results showed that the iterative method could effectively segment the near-infrared and visible soybean canopy images, and the effective segmentation rate was 97.81% and 87.99% respectively. The segmentation effect of green, red and red edge soybean canopy images was poor, and the effective segmentation rate was less than 70%. Otsu and local threshold methods could effectively segment the other four kinds of multispectral soybean canopy images except for red light, and the effective segmentation rate was more than 82%. The effective segmentation rate of the three algorithms for red soybean canopy images was less than 20%, which did not achieve good results. In the original multispectral image, iterative method, Otsu method, and local threshold method were used to extract the mean value of information entropy of soybean canopy image and standard image, and the fluctuation amplitude was 0.120 1, 0.054 7, and 0.059 8, respectively. Otsu and local threshold methods were smaller, showing the effectiveness of the two algorithms in soybean canopy multispectral image recognition. The Otsu and local thresholding methods could effectively extract the soybean canopy images of green light, near-infrared, red edge, and visible light. Both of them retained the soybean canopy information completely. Otsu method had better real-time performance than the local thresholding method. The results provided a theoretical basis and technical reference for extracting crop canopy multispectral images.

农作物冠层多光谱图像能够表征作物长势、 营养和病虫害等情况[1], 通过获得农作物冠层多光谱成像信息, 实现农作物生理生态信息的无损快速检测, 得到了智慧农业领域的广泛应用。 特别是近地多光谱技术具有仪器成本低、 检测便捷和图像分辨率高等优点, 获取植株生态学和形态学的性状指标[2], 对于农作物优良品种选育和科学栽培具有重要理论意义和实用价值。 农作物冠层多光谱成像信息获取及处理是智慧农业领域中重要的组成部分, 但由于多光谱图像通常存在边缘模糊, 目标与背景之间灰度差别小等问题[3], 目前针对多光谱图像的分割方法效率较低, 难以对图像模糊信息进行准确识别, 低对比度图像的边缘部分和模糊部分识别效果较差。 基于阈值分割算法广泛应用于彩色图像的目标区域识别中, 为多光谱图像中精准识别农作物冠层提供了理论指导。 傅隆生等[4]提出了一种基于卷积神经网络的田间猕猴桃果实图像的识别模型可以准确识别出猕猴桃果实, 但对于一些遮挡和重叠果实没有达到很好的效果。 GrabCut算法[5]依据图像RGB混合高斯模型结合用户交互实现图像分割算法, 但对背景比较复杂的图像分割效果较差。 采用图像特征分类器可以有效提取目标区域, Wang等[6]在自然环境下实现了杂草图像预处理、 分割、 特征提取和分类检测。 刘立波等[7]提出一种改进全卷积网络的棉田冠层图像分割方法, 可以准确分割出冠层目标区域, 但是未对冠层图像中的阴影部分和光照部分进行区分。 Bai等[8]利用SVM分类器和卷积神经网络相结合, 建立错分率较低的水稻冠层分割方法, 但该模型对计算机硬件要求较高。 上述研究成果为解决自然环境下农作物冠层多光谱图像存在边缘模糊, 目标区域与背景区域之间灰度差别小等问题提供了理论和技术基础。 本文以大豆冠层多光谱图像为研究对象, 将经典阈值分割方法应用于多光谱图像, 通过高斯平滑滤波法对原始大豆多光谱图像进行处理, 在此基础上利用迭代法、 Otsu法和局部阈值法提取原大豆多光谱图像中冠层区域, 并以图像形态学开运算处理细化和扩张背景, 避免图像区域内干扰噪声对大豆冠层识别效果的影响, 最终得到了相对较好的分割效果。 同时采用有效分割率、 过分割率、 欠分割率以及信息熵为监督指标客观评价模型有效性。 该模型避免了近地端多光谱图像边缘灰度不均, 目标与背景之间灰度差别小难以准确提取大豆冠层多光谱图像区域的不足, 为农作物冠层多光谱图像快速识别与图像理解提供理论依据和技术借鉴。

试验使用Sequoia多光谱相机对盆栽大豆进行拍摄, 该相机可以获取5种谱段的光谱成像数据, 包括绿光(GRE)、 近红外(NIR)、 红光(RED)、 红边(REG)及可见光(RGB)图像, 对应波长范围分别为(550± 40), (790± 40), (660± 40), (735± 10)和380~780 nm。 试验采用垂直拍摄, 设定相机距冠层1.5 m。 获取了大豆五种多光谱图像(见图1), 共计105组样本。

为克服噪声在图像采集过程中的影响, 应用均值滤波和高斯平滑滤波两种方法, 对多光谱图像进行降噪处理(图2), 以去除对冠层提取干扰因素的影响。 并采用峰值信噪比(PSNR)和结构相似性(SSIM)作为评价指标, 对预处理后的多光谱图像进行质量评价, 以选取最优降噪处理方法。

多光谱图像降噪评价指标均为全参考的图像质量评价指标[9], 其中PSNR计算公式为

$PSNR=10\text{lo}{{\text{g}}_{10}}\frac{{{({{2}^{n}}-1)}^{2}}}{\frac{1}{H\times W}\overset{H}{\mathop{\mathop{\sum }_{i=1}}}\,\overset{W}{\mathop{\mathop{\sum }_{j=1}}}\,{{(X\left( i,j \right)-Y\left( i,j \right))}^{2}}}$(1)

式(1)中, X为去噪图像, Y为原始图像, H和W分别为图像的高度和宽度, n为每像素的比特数, PSNR数值越大表示图像失真越小。

由于人类视觉很容易从图像中抽取出结构信息, 计算SSIM指标评价两幅图像结构信息的相似性, 其计算公式为:

式(2)中, l(X, Y)为图像亮度变化, c(X, Y)为图像差异变化, s(X, Y)为图像结构变化; 结构相似性是用来评测图像质量的一种方法, 数值越大表示图像失真越小。

由表1可知, 均值滤波和高斯平滑滤波处理的多光谱图像PSNR平均值分别为35.158 4和36.613 8, SSIM平均值分别为0.930 2和0.947 8。 对多光谱图像进行去噪处理, 高斯平滑滤波处理的PSNR和SSIM都优于均值滤波处理, 保持了大豆多光谱图像边缘等细节信息, 能够较为完整的保存大豆多光谱图像的原有信息, 因此采用高斯平滑滤波法进行大豆多光谱图像的滤波降噪处理。

| 表1 多光谱图像预处理评价指标 Table 1 Multispectral image preprocessing evaluation index |

采用了全局阈值迭代法, Otsu法以及局部阈值法对大豆冠层进行分割, 然后对图像进行开运算处理, 即在图像中利用结构元素先进行腐蚀运算再进行膨胀运算, 细化处理图像用以消除孤立点毛刺[10], 真实可靠地保留了大豆冠层图像信息。

1.3.1 迭代阈值法

迭代阈值法是一种能基于图像数据自动选择阈值算法, 首先选定一个初始阈值, 然后按某种策略不断地更新阈值, 直到满足算法给定收敛准则为止。 研究中将大豆图像灰度范围的中值作为初始阈值T0(设图像共有L个灰度), 该算法迭代公式为

${{T}_{i+1}}=\frac{1}{2}\left\{ \frac{\overset{{{T}_{i}}}{\mathop{\mathop{\sum }_{k=0}}}\,{{h}_{k}}k}{\overset{{{T}_{i}}}{\mathop{\mathop{\sum }_{k=0}}}\,{{h}_{k}}}+\frac{\overset{L-1}{\mathop{\mathop{\sum }_{k={{T}_{i}}+1}}}\,{{h}_{k}}k}{\overset{L-1}{\mathop{\mathop{\sum }_{k={{T}_{i}}+1}}}\,{{h}_{k}}} \right\}$(3)

式(3)中, hk是图像中灰度值为k的像素点个数; 当迭代至Ti+1=Ti时, 确定Ti为分割阈值。

采用迭代阈值法分割大豆多光谱图像时, 绿光、 近红外、 红光、 红边及可见光大豆多光谱图像的阈值分别为0.495 4, 0.534 4, 0.476 5, 0.241 5和0.551 6, 计算获取大豆冠层的五种多光谱图像; 同时计算大豆冠层多光谱图像的灰度直方图, 大豆冠层多光谱图像效果和对应直方图如图3所示。

从图3可以看出, 采用迭代法获取冠层多光谱图像的平均灰度值依次为0.584 7, 0.825 1, 0.621 4, 0.342 5和0.636 9, 各直方图分别在0.502 0, 0.909 8, 0.502 0, 0.345 1和0.619 6处达到峰值, 并且较为完整地分割出了近红外和红边通道的大豆冠层的目标区域。 由于绿光和红光的大豆图像的目标区域边缘模糊且与大豆图像背景区域颜色相近, 导致不能有效获取大豆冠层的目标区域图像; 该算法分割出了可见光通道的大豆冠层区域, 但也留存了原图像的部分背景区域。

1.3.2 最大类间方差法

最大类间方差法(OTSU)是将大豆灰度直方图在某一阈值处分割成两组, 二者灰度值的最大方差就是分割算法阈值。 最大类间方差法定义为: 假设ω 0为大豆冠层像素点数占整幅图像的比例, μ 0为其平均灰度; ω 1为背景像素点数占整幅大豆图像的比例, μ 1为其平均灰度; 则大豆冠层和背景图像之间方差表示为

当方差g最大时, 待处理图像中大豆冠层和背景差异最大, 该灰度值是大豆冠层多光谱图像分割的最佳阈值。 本文确定绿光、 近红外、 红光、 红边及可见光大豆多光谱图像的最佳阈值分别为0.419 6, 0.494 1, 0.400 0, 0.176 5和0.588 2, 通过计算获得多光谱大豆冠层图像, 并计算相应图像的灰度直方图, OTSU算法分割效果如图4所示。

从图4中可以看出, 采用Otsu法获取冠层多光谱图像的平均灰度值依次为0.537 6, 0.813 4, 0.532 7, 0.324 3和0.651 2, 各直方图分别在0.502 0, 0.909 8, 0.419 6, 0.345 1和1.666 7处达到峰值, 该算法较为完整地分割出了近红外和红边通道的大豆冠层的目标区域, 由于红光图像边缘灰度级分布不均且噪声较大, 目标与背景之间灰度差别小, 导致不能有效获取目标区域图像。 然而对于绿光和可见光大豆冠层, 虽提取出了目标区域, 但也损失了冠层部分有效信息。

1.3.3 局部阈值法

局部阈值分割算法是将原始图像划分为若干子图像, 并逐层迭代求解各子区域的最优局部阈值, 将最优局部阈值合并作为分割阈值, 从而实现从多光谱图像中分割出大豆冠层。 通过迭代计算绿光、 近红外、 红光、 红边及可见光大豆多光谱图像的局部阈值, 计算图像的最优分割阈值分别为0.325 5, 0.380 4, 0.302 0, 0.094 1和0.431 4, 进一步获得大豆冠层的多光谱图像, 并计算对应灰度直方图, 该算法效果如图5所示。

从图5中可以看出, 采用局部阈值法获取冠层多光谱图像的平均灰度值依次为0.539 7, 0.815 9, 0.477 8, 0.324 7和0.635 4, 各直方图分别在0.502 0, 0.909 8, 0.396 1, 0.345 1和0.619 6处达到峰值, 局部阈值法较为完整地分割出了绿光、 近红外和红边通道的大豆冠层的目标区域, 对于红光大豆冠层没有达到理想分割效果, 也保留了部分绿光大豆冠层的边缘区域; 该算法分割出了可见光通道的目标冠层区域, 同时也漏分了部分背景区域。

采用迭代阈值算法、 Otsu阈值算法和局部阈值算法提取了大豆冠层图像, 通过对比不同算法获取大豆冠层多光谱图像的灰度直方图并分析大豆冠层和背景的灰度直方图分布特性。 为进一步客观定量评价三种算法提取大豆冠层的多光谱图像质量, 计算了图像的有效分割、 欠分割、 过分割以及信息熵, 作为大豆冠层多光谱图像分割质量定量评价标准。

依据文献[11]计算105组大豆多光谱图像的有效分割率、 过分割率和欠分割率, 并进行了绿光、 近红外、 红光、 红边及可见光等五种多光谱冠层图像统计分析, 其中有效分割率越高且过分割率和欠分割率越低, 表示算法分割性能越好[12]。 其结果如表2所示。

| 表2 不同分割算法的评价指标对比 Table 2 Comparison of evaluation indexes of different segmentation algorithms |

从表2统计结果可知, 采用Otsu法和局部阈值法对绿光大豆冠层图像平均有效分割率均在87%以上, 识别效果相对迭代法较好。 三种算法都有效区分了近红外大豆图像中的冠层和背景, 其冠层区域平均有效分割率均在96%以上, 但对红光大豆冠层图像的有效分割率均低于20%。 Otsu法和局部阈值法都比较有效区分了红边大豆图像中的冠层和背景, 目标区域的平均有效分割率均在97%以上, 而迭代法在分割红边大豆图像时, 由于周围环境的影响, 图像分割效果不稳定。 三种算法都有效区分了可见光大豆图像中的冠层和背景, 其中迭代法和局部阈值法对可见光大豆冠层图像的平均有效分割率均在85%以上。 同时, 在五种光谱图像中, 红光大豆冠层的有效识别率最低, 过分割率和欠分割率最高。 采用迭代法、 Otsu法和局部阈值法分割绿光、 近红外、 红外和可见光的平均过分割率分别为30.41%, 17.61%和15.65%, 平均欠分割率分别为32.56%, 25.25%和28.54%, 采用Otsu法和局部阈值法对大豆冠层多光谱图像的过分割率和欠分割率较迭代法更低, 分割效果更好。 在计算速度方面, 迭代法和Otsu法平均计算时间分别为7.75和7.48秒; 而局部阈值法对图像多区域分别进行分割处理操作, 其平均计算时间为50.52 s, 处理时间较长; 综合大豆冠层图像提取效果, Otsu法从时间性能上优于其他两种算法。

图像的信息熵表示图像所包含的平均信息量, 分割后冠层图像相对标准图像熵值变化越小表明图像分割效果越好[13]。 本研究评价算法有效性和信息完整性的信息熵公式为

$\text{H}\left( \text{X} \right)=-\overset{n}{\mathop{\underset{i=1}{\mathop \sum }\,}}\,p\left( {{x}_{i}} \right)\text{log}p\left( {{x}_{i}} \right)$(5)

式(5)中, p(xi)为灰度值为xi的像素数与图像总像素数之比。

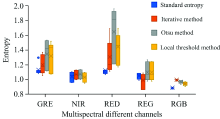

按照式(5)计算105组分割图像与标准图像的信息熵, 其结果如图6所示。

从图6中可以看出, 红光大豆图像算法分割后图像信息熵与标准图像数据相差较大, 其最大差值达到0.319 7, 因为红光波段是叶绿素的主要吸收波段, 对土壤和绿色植物类别差异并不敏感, 其图像颜色较暗, 边缘特征模糊不均, 所以该光谱波段图像分割较为困难。 利用迭代法、 Otsu法和局部阈值法分割的多光谱大豆冠层图像和标准图像平均熵值范围分别为0.884 7~1.302 3, 0.865 4~1.690 4, 0.930 9~1.958 2, 0.905 4~1.695 4, 其目标图像与标准图像信息熵的平均值之差分别为0.120 1, 0.054 7和0.059 8, 所以Otsu法和局部阈值法分割后冠层图像相对标准图像信息熵变化较小, 目标图像保留了大豆冠层中多光谱数据的有效信息。

针对大豆冠层提取时多光谱图像的目标与背景之间灰度差别小且边缘灰度不均的问题, 提出了基于多光谱图像处理技术的大豆冠层提取方法, 并利用多种图像指标对大豆冠层多光谱图像识别效果进行了定量化评价, 其中Otsu法和局部阈值法均可以有效提取绿光、 近红外、 红边和可见光等多光谱的大豆冠层图像, 二者较为完整地保留了大豆冠层信息, 且Otsu法实时性优于局部阈值法, 为自然环境下提取农作物冠层多光谱图像提供理论依据和技术借鉴, 为后期仪器开发, 大豆科学栽培与精细管理提供可靠的分割模型。

(1)在三种分割算法中, 采用迭代法可以有效分割近红外和可见光大豆冠层图像, 有效分割率分别为97.81%和87.99%, 对绿光、 红光和红边大豆冠层图像分割效果较差, 有效分割率低于70%; 采用Otsu法和局部阈值法可以有效分割除红光波段的其余四种大豆冠层图像, 且有效分割率均在82%以上; 三种算法对红光大豆冠层图像的有效分割率均低于20%, 未达到较好效果。 在五种光谱图像中, 近红外大豆冠层的有效分割率最高, 三种方法有效分割率均在94%以上, 且过分割率和欠分割率低至7.91%和13.16%。

(2)通过对比三种算法的有效分割率、 过分割率、 欠分割率、 信息熵以及运行时间等分割评价指标, Otsu法和局部阈值法对多光谱图像的平均有效分割率对比迭代法分别提高11.57%和13.93%, 分割效果较迭代法更好, 适宜多光谱大豆冠层图像分割, 而Otsu法单幅图像平均处理时间更快, 在时间性能上优于局部阈值法, 且信息熵值变化小, 保留了更多的有效信息, 具有快速准确的特性。

| [1] |

|

| [2] |

|

| [3] |

|

| [4] |

|

| [5] |

|

| [6] |

|

| [7] |

|

| [8] |

|

| [9] |

|

| [10] |

|

| [11] |

|

| [12] |

|

| [13] |

|