作者简介: 谭 翔, 1978年生, 北京大学地球与空间科学学院博士研究生 e-mail: 598051000@qq.com

无人机加载红外光谱载荷对区域内影像进行获取现已成为遥感领域一种重要的技术手段, 可通过对携带位置信息的影像进行分类提取, 得到植被盖度、 温度指数等一系列因子指标。 利用FREE BIRD(自由鸟)小型低空无人机系统挂载Tetracam红外相机(310万像素)对新疆玛纳斯县一河道进行影像获取。 无人机飞行面积约为20.5 km2, 为了得到更加精确的植被、 温度等因子, 需要对无人机红外影像进行配准, 通过优化SIFT匹配参数和RANSAC粗差剔除后, 获取了可靠的匹配结果, 即经过算法匹配后的影像与原影像进行了误差比对, 能够满足后期的应用需要, 这也是本文的创新点之一。 将影像进行配准后进行二维影像拼接, 将多张红外影像按照航向重叠度不低于60%, 旁向重叠度不低于50%的概率进行拼接, 得到拼接后的红外影像图。 另外比较了SIFT和SUFT两种算法, 利用优化的SIFT算法及改进的FLIR传感器获取1 600张热红外影像, 利用地面同步测量数据对拼接后的红外影像进行算法匹配, 并利用ENVI(完整的遥感图像处理平台)软件进行温度及植被盖度的影像反演, 得到了研究区域的单一影像及红外影像的温度反演图及植被反演图。 通过对两种算法的对比得到更加优化的算法模型, 并对该模型进行回归分析和精度检验, 得到该模型的相关系数 R2为0.767, 匹配精度为81.51%, 模型精度较高。 本模型的建立对日后无人机红外影像的配准及提取反演奠定了理论和实践基础。

UAV loading infrared/near-infrared spectroscopy on regional image acquisition load has become an important field of remote sensing technology, through classifying the position information of the portable image, and getting the vegetation cover, temperature index and a series of factors. In this paper, we used FREE BIRD low altitude unmanned aerial vehicle (UAV) to mount Tetracam- infrared camera (3 million 100 thousand pixels) to get the image of a river in Xinjiang, Manasi. In order to get more accurate vegetation temperature and other factors, we needed UAV infrared/near infrared image registration, through the optimization of SIFT, detection of outliers and RANSAC parameters, to obtain reliable matching results. After the matching algorithm of the image ,the original image of the error ratio were below 60%, which was one of the innovations of this paper to meet the needs of the application. After registering the images, the images were spliced, and the infrared images were spliced according to the degree of overlap of the course of not less than 60%, while the probability of the adjacent overlap was not less than 50%. At the same time, this paper compared the SIFT and SUFT two kinds of algorithms, using FLIR sensor SIFT algorithm and improved optimization to obtain 1 600 thermal infrared image matching and image inversion of ground by utilization of synchronous measurement data. We used ENVI software to carry out the inversion of vegetation coverage temperature inversion and inversion vegetation map to get the single image and the infrared image of the study area. The algorithm model is more optimized through the comparison of the two algorithms, while the model of regression analysis and test of accuracy, the correlation coefficient R2 of the model is 0.767, and accuracy is 81.51% with higher model precision. This model provides theoretical and practical basis for the registration and extraction of inversion of UAV infrared image.

引 言

无人机低空遥感技术以其方便灵活、 使用成本低、 响应快速、 厘米级数据成果等优势迅速得到了各行各业的认可, 并成为航空航天遥感的重要补充手段。 传统的无人机飞行平台存在很多不足, 如因有效载荷较小而极大地限制了其机载传感器的发展。 目前无人机载传感器以可见光数码相机为主, 在国土资源测绘等多个领域取得了很好的应用效果[1]。 但是对于地质、 生态环境等领域, 其所获取的数据因光谱范围有限而使其应用范围受限。 随着技术的发展, 目前无人机载传感器也加速了发展, 由传统可见光向多/高光谱方向发展[2]。 但这些传感器大多并不是只为遥感设计, 因此其数据质量及成像模式与传统遥感数据不同, 存在相幅小, 噪声大等问题。 同时由于无人机平台自身姿态差等劣势, 在后期成图处理中, 传统的软件难以处理这类数据, 匹配结果不能满足处理需要而不能实现数据成图[3]。 现在无人机上可搭载的遥感传感器包括中小幅面可见光波段相机、 多光谱相机、 高光谱相机、 热红外相机, 激光测距(LiDAR), 合成孔径雷达(SAR)等覆盖整个电磁波谱段的遥感设备。

目前, 在无人机影像匹配方面, 传统的角点检测算法, 例如Harris算子不能很好地处理不同尺度的影像, 而FAST和BRIEF特征不是旋转不变的, MSER算法在高对比度的影像区域表现更好。 虽然目前提出了一些诸如ORB和FREAK的匹配算法, 然而SIFT还是最被认可的算子[4]。 但SIFT算法是以解决可见光影像为主, 其参数设置都以可见光影像为对象, 因此直接将红外影像用与SIFT匹配难以得到准确的匹配结果, 甚至匹配失败。

由于本文采集的为无人机红外影像数据, 根据红外数据特点, 不能单一的通过利用SIFT算法进行匹配, 而是对比了SIFT和SUFT两种算法后利用优化的SIFT匹配参数和RANSAC粗差剔除, 获得可靠的匹配结果, 通过GPU(显示芯片)的应用, 提高算法的效率, 为了使本研究的方法能够满足实际应用的需要, 为无人机载红外传感器的应用提供帮助, 研究中得到了匹配优化模型并计算了优化精度, 确保了无人机数据在后期的二维正射影像拼接及三维实景模型研建过程中的精度。 在该模型下将进一步提高无人机在地质、 环境等领域的应用能力。

利用近红外遥感技术来获取地球热状况的信息是一个非常重要的手段, 而红外光谱影像的获取原理就是根据地物发射电磁波的频率不同以及辐射的热红外线不同, 再利用近红外成像仪来获取不同地物的遥感影像[5]。 随着科技的发展, 利用无人机获取近红外光谱数据的技术愈发广泛。 本研究利用FREE BIRD(自由鸟)小型低空无人机系统挂载Tetracam红外相机(310万像素)对新疆玛纳斯地区一河道进行影像获取。 利用获取的红外遥感影像数据进行优化的SIFT匹配参数和RANSAC粗差剔除分析。

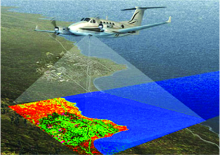

利用巡航速度为60 km· h-1, 续航时间为1 h, 起飞载荷重量为2.5 kg, 飞行高度可达海拔4 000 m的FREE BIRD(自由鸟)小型低空无人机系统挂载Tetracam红外相机(310万像素)另外对一河道进行影像获取。 无人机飞行面积约为20.5 km2, 共获取热红外影像数据1 600张, 全部为红外影像数据。 无人机挂载红外载荷获取数据的过程如图1所示。

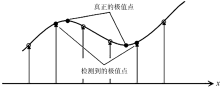

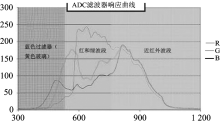

SIFT算法通常在Lowe(SIFT算法的作者)设置的默认参数下运行, 而一般应用时并不针对不同的影像类型进行参数调整[6]。 因此, 造成对于一些特殊的影像数据难以获取足够多的特征点。 实际上, 为了匹配非可见光波频谱范围数据, 也提出了一些SIFT的改进方法来提高匹配结果, 例如尺度限制准则和描述子改进方法。 更改SIFT的参数在多波段数据集的特征点检测和匹配中已获得成功, 例如近红外传感器得到的无人机获取的影像数据灰度图和可见光影像之间的匹配, 或是无人机获取的高光谱短波红外影像和可见光影像之间的匹配[7]。 随着技术的进步和需求的增长, 优化SIFT算法对多/高光谱数据的适用性变得十分有意义。 SIFT主要包含四个步骤: 极值检测、 特征点定位、 主方向分配和特征点描述子生成。 控制第一阶段的三个主要参数是: octave数, 每个octave第一级的初始高斯平滑模板大小(由参数σ 决定和每个octave的尺度数(Scales)[8]。 第二阶段低对比度区域的不稳定潜在关键点用阈值参数CT(contrast threshold)去除, 位于边缘的不稳定潜在关键点用阈值参数ET(edge threshold)去除。 匹配描述子时需要确定nnRatio参数, 用于排除错误匹配。 Lowe推荐nnRatio的阈值为0.8[9, 10, 11]。 如图2所示。 虽然SIFT匹配算法共有17个参数控制整个SIFT特征点检测和匹配流程, 但在考虑其重要性、 参数敏感性和控制优化复杂度基础上, 选择了其中最关键的是5个参数: σ , nScales, CT, ET, nnRatio作为优化参数[12, 13]。 本实验所采用的Tetracam相机波段特征如图3所示。

SUFT算法是Bay等于2006年提出的快速鲁棒特征提取算法, 在算法SIFT的基础上对DoH矩阵检测特征点简化近似, 并利用盒子滤波的方式使得耗时的影像高斯平滑运算效率显著提高, 最后利用Haar小波变换, 采用二值的方法在图像中快速找到特征。 Bergman等通过对SIFT算法和SURF进行了对比分析实验, 表明SIFT算法在运算速度上要落后于SURF, 具有较好的特征提取性能, 需要根据不用应用场景选择合适的局部特征提取方法[14]。

积分影像上任意一点的灰度值为影像左上角到这个点所构成的矩形区域内点的灰度值之和。 积分图像任意一点(i, j)的值I(i, j), 可由式(1)表示为式(1)

式(1)中, p(i', j')为原影像上的灰度值, 如果计算一个区域的ξ 积分, 利用积分图像的概念, 可由区域四角点的积分值进行计算得到, 表明区域的像元灰度与窗口的尺寸大小没有关系。 积分图像区域的ξ 的灰度和为式(2)

将利用SIFT计算量小, 速度快, 影像精确的特点对无人机航拍影像进行校准和比对。

通过无人机获取的河道红外波段灰度影像如图4所示, 存在河道地区影像纹理不清晰等特点, 这将对无人机红外影像的后期拼接及建模造成影响, 或造成拼接错误率上升甚至拼接失败的结果。 而经过SUFT算法改进测试后得到的影像对比如图5所示, 可清晰地分析出不同地物的属性特征, 可利用清晰的地物属性为后期的提取分析奠定基础。

采用的SIFT算法优化主要由以下方程得出:

(1)Levenberg-Marquardt算法是有效的迭代求精算法简称为L-M算法, 见式(3)

(2)L-M算法收敛, 见式(4)

其中f对p的雅克比行列式为J(p), 见式(5)

(3)L-M算法进行全局优化拼接, 见式(6)和式(7)

式中, N为参与计算的基准面坐标个数, 以此作为全局优化的目标代价函数, 理论上当获得精确的绝对单应矩阵时, 代价函数的值应为零, 而实际上ε error是在不断迭代的过程中趋于稳定见式(8), 以此作为迭代收敛结束的依据, 此处阈值为0.01, 即表明迭代变化精度趋于稳定。 利用式(3)求解最终的经绝对单应矩阵变换的基准面坐标, 实现全景影像的拼接。 经过算法匹配后的影像与原影像进行了误差比对, 如表1所示, 均在60%以下, 说明SIFT匹配对影像提取具有校准作用, 此法可行。

| 表1 影像间匹配误差(像素) Table 1 Image matching error (pixel) |

无人机加载红外载荷获取了红外影像数据, 由于红外影像纹理差等特点, 为了增加匹配结果, 进行SIFT参数优化设置, 但同时也增加了错误匹配, 因此通过RANSAC进行错误结果剔除。

首先图6(a)所示为使用SIFT默认参数对红外影像进行匹配的结果。

通过图中所示结果可知默认参数的SIFT匹配对城区等纹理较好区域能够获取较多匹配结果, 但对于草原等纹理较差区域难以获取可用的匹配结果。 因此, 通过本优化的匹配参数进行处理, 可得到如图6(b)所示结果。

优化后参数能够较好的增加匹配结果数量, 尤其是对草原弱纹理区域亦能获取较均匀匹配结果, 但同时也带来了较多错匹配结果。

最后, 对利用本文优化参数的匹配结果进行RANSAC错误剔除, 其结果如图6(c)所示。 利用SIFT优化参数及RANSAC错误剔除, 红外影像匹配获取了可靠的匹配结果, 能够满足后期应用需要。

最后, 利用优化的SIFT算法及改进的FLIR传感器沿河道获取20.5 km2共计1600张热红外影像, 同时利用无人机专用拼接软件进行影像的二维影像拼接, 利用地面同步测量数据, 经过辐射定标、 温度反演等步骤, 利用ENVI软件处理拼接后的红外影像数据后得到河道及周边地物的温度反演结果, 如图7所示。 该结果经过遥感反演可得到不同波段的温度及植被反演图, 可以在温度及植被分析方面得到广泛的应用, 这就说明利用旋翼或固定翼类型无人机获取热红外影像数据同卫星影像一样可以满足遥感应用要求, 而无人机获取红外影像的最大特点则是具有时效性、 清晰度高、 影像处理迅速等特点, 能够为日后相关部门的数据更新及分析提供很好的获取途径。

通过对SIFT优化匹配和RANSAC错误结果剔除建立的模型进行多元线性回归分析, 如表2。 得到相关系数R2为0.767, 相关度较高。 同时针对红外光谱提取分类反演的各类植被及温度因子进行精度分析, 如表3, 得到该模型的精度为81.51%, 则通过SIFT优化匹配后的模型更能够满足后期需要。

| 表2 多元线性回归模型的精度与方差分析 Table 2 Precision of multiple linear regression model and variance |

| 表3 多元线性回归误差分析/% Table 3 Analysis of multiple linear regression error/% |

利用无人机红外载荷获取红外光谱影像数据现已成为获取重点区域遥感数据的重要手段, 基于无人机红外影像的获取需要对影像进行算法匹配才能够进行无人机影像拼接及温度、 植被等的精确反演。 本文所获取的1 600张无人机红外影像经过SIFT算法与SURF算法进行实验对比, 得出经过SIFT优化匹配和RANSAC错误结果剔除后的影像精度更加精确。 利用SIFT匹配模型对获取的影像数据的高程、 提取的植被覆盖指数等因子进行精度检验。 得出: 经过优化后的影像, 其精度达到了80%以上。 这对日后获取重点区域高精度地物提取奠定了理论及实验基础。

The authors have declared that no competing interests exist.

| [1] |

|

| [2] |

|

| [3] |

|

| [4] |

|

| [5] |

|

| [6] |

|

| [7] |

|

| [8] |

|

| [9] |

|

| [10] |

|

| [11] |

|

| [12] |

|

| [13] |

|

| [14] |

|